2024年5月、対話型生成AIを利用してコンピュータウイルスを作成したとして容疑者が逮捕される事件が報道されました。読売新聞オンラインによると「ランサムウェアをつくり、楽に稼ごうと思った。AIに聞けば何でもできると思った」と供述しているそうです。

本来であれば大手の生成AIには「ガードレール」と言われる悪用防止機能が実装されており、ウイルスを作成するプログラムなどの回答は、拒否されるようになっています。しかし、今回の事件では、ネットで不正に回答を得る方法を調べ、遠回しな質問を繰り返すことで設計情報を聞き出していたと見られています。

生成AIは、サイバー犯罪に利用されないように様々な対策や改善が行われてきました。生成AIに指示する質問のことを「プロンプト」と言い、生成AIを意図的に誤作動させて回答を生成させるプロンプトのことは、「プロンプトインジェクション(脱獄用プロンプト)」と呼ばれています。プロンプトインジェクションは様々な種類があり、例えば「Do Anything Now」というプロンプトは、生成AIの制限を外すよう指示する手法です。こうしたプロンプトは、アップデートのたびに無効化されています。

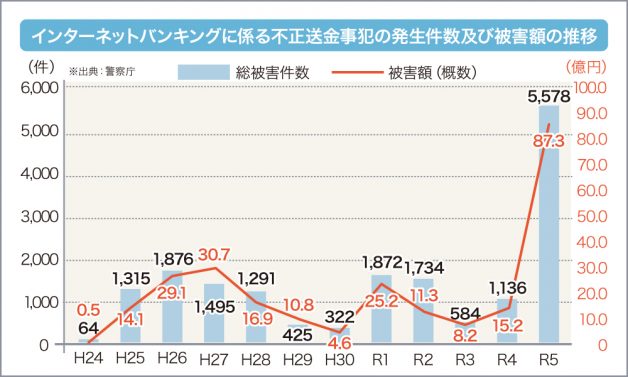

生成AIのサイバー犯罪への利用と思われる身近な事例として、フィッシングメール・ビジネスメール詐欺(BEC)の増加・巧妙化が挙げられます。その背景には、OpenAI社がChatGPTを公開して以降、各社が続けて公開した生成AIサービスの存在があります。これまでのフィッシングメールであれば、海外の犯罪集団が日本語訳をする例が多く、文面のおかしいことで詐欺の真偽を判断できましたが、生成AIがつくり出した質の高い日本語メールの偽装を果たして見破ることができるでしょうか。右上図の「インターネットバンキングに係る不正送金事犯の発生件数及び被害額の推移」からも、その結果はあきらかです。

従業員への情報セキュリティ教育が実施されていない会社も多いかもしれませんが、このような実態をまずは知り、注意する意識を持つことが重要でしょう。ビジネスメール詐欺に多い、取引先を偽装して支払先口座の変更連絡をする事案などは、取引先に1本電話確認を入れるだけで防ぐことができます。生成AIの回答と同じように最後にそれが正しいのかを判断するのは「人」です。セキュリティ対策の一環として、情報セキュリティ教育にも取り組んでいきましょう。

関連リンク

| 情報提供:地域貢献事業部 サイバーセキュリティ担当 藁科 |